applewatchmirroring推出新功能

IT之家5月17日消息 , 苹果官方展示融合强大软硬件与机器学习性能的创新辅助功能 , 定于今年晚些时候推出的软件功能将为残障用户提供全新工具 , 涵盖导航、健康、交流等多种功能 。

文章图片

文章图片

【applewatchmirroring推出新功能】Apple今日展示了创新软件功能 , 这些功能将为残障用户提供导航与交流的新方式 , 帮助他们充分利用Apple产品 。这些强大更新凝聚了公司最新技术 , 为用户带来可个性化设置的独特工具 , 持续兑现Apple的长期承诺——制造所有人都能顺畅使用的产品 。

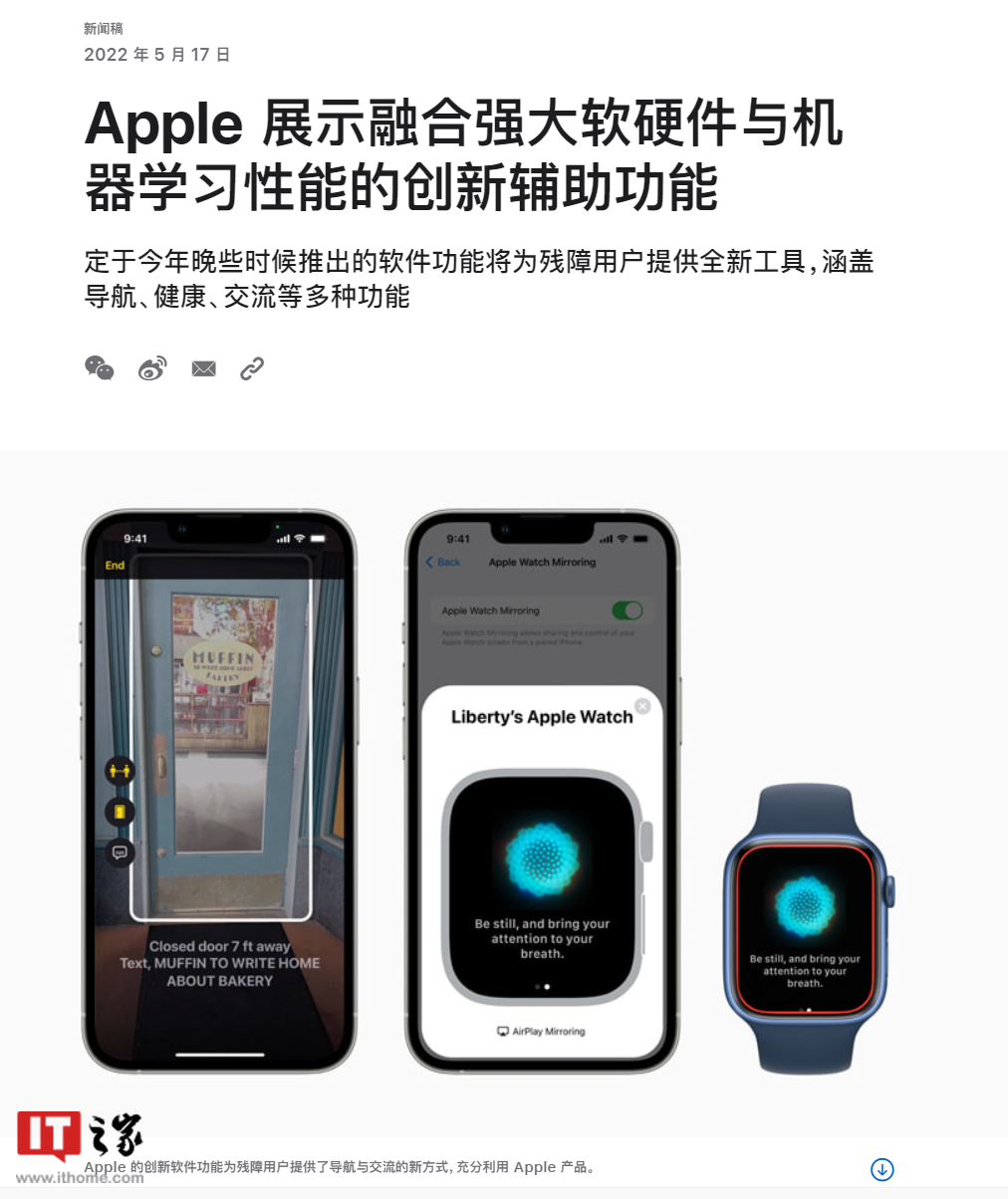

借助先进的软硬件与机器学习性能 , 失明或低视力人士可以使用门检测 , 用iPhone或iPad引导自己顺利走完通向终点的最后几步;肢体或运动障碍用户借助语音控制与切换控制等辅助功能 , 可以在iPhone上使用AppleWatchMirroring(镜像)完全控制AppleWatch;失聪与重听人士可以在iPhone、iPad与Mac上观看实时字幕 。Apple还将拓展对行业领先的屏幕阅读工具——旁白功能的支持 , 新增超过20种语言与地区选项 。这些功能将于今年晚些时候通过软件更新登陆Apple各大平台 。

为失明或低视力用户设计的门检测

Apple即将推出门检测 , 这是一项专为失明或低视力人士设计的先进导航功能 。门检测可以帮助用户在即将抵达新终点时确定大门的位置 , 告诉他们离门有多远 , 并描述门的特性 , 包括门是开还是关 。如果门是关着的 , 它还能告诉用户是否可以通过推、拉或旋转把手来开门 。门检测还能朗读门上及周围的标牌和标志 , 比如办公室的房间号 , 或者无障碍入口标志 。这项新功能结合了激光雷达扫描仪、摄像头与设备端机器学习性能 , 将在配备激光雷达扫描仪的iPhone与iPad机型上推出 。

门检测将成为放大器App中的一个新检测模式 。放大器是Apple为失明及低视力用户设计的内置app 。门检测与人物检测和图像描述功能可在检测模式中分别或同时使用 , 为视障用户提供可自定义设置的工具 , 帮他们导航并获取身边环境的丰富信息 。除了放大器App内的导航工具 , Apple地图App也为使用旁白功能的用户提供了声音与触感反馈 , 用于识别步行导航的起始点 。

推进AppleWatch的肢体与运动辅助功能

AppleWatchMirroring可以帮助用户使用配对的iPhone远程控制AppleWatch , 从而让肢体或运动障碍人士能更加便捷地使用AppleWatch 。通过AppleWatchMirroring , 用户可以使用iPhone的语音控制和切换控制等辅助功能控制AppleWatch , 并使用语音命令、声音指令、头部追踪等输入方式 , 或者MadeforiPhone外部辅助切换设备做为轻点AppleWatch显示屏的替代操作 。AppleWatchMirroring借助软硬件功能 , 包括基于隔空播放的技术 , 帮助依赖这些功能的用户顺畅使用AppleWatch独有的app , 如血氧、心率、正念等等 。

此外 , 用户还可以使用简单的手势进一步控制AppleWatch 。通过AppleWatch上新的快速操作 , 用户可通过“两次捏合”手势接听或挂断电话、忽略通知、拍摄照片、在播放中App里播放或暂停媒体 , 以及开始、暂停或继续体能训练 。这项功能基于AppleWatch辅助触控中使用的创新技术 , 让上肢不便的用户能以不同方式控制AppleWatch , 如捏合或握拳 , 而不必轻点显示屏 。

iPhone、iPad与Mac为失聪与重听用户推出实时字幕功能

Apple为失聪与重听人士在iPhone、iPad与Mac上推出实时字幕3 。用户可以更轻松地理解任何音频内容——包括电话或FaceTime通话、视频会议或社交媒体app、流媒体内容 , 或是与人面对面交谈 。用户可以调整字幕字体大小 , 方便阅读 。FaceTime通话实时字幕可为通话参与者提供自动转写的对话字幕 , 让听障人士更方便地参与群组视频通话 。在使用Mac通话时 , 用户可以输入回复 , 让实时字幕为其他通话参与者实时朗读回复内容 。实时字幕在设备端生成 , 因此用户可以确保信息隐私与安全 。

- 彭博社:ios16公共测试版比平时晚一些推出

- uber推出自动驾驶送餐试点项目

- 天翼云推出七大云服务新品:混合云一体机、裸金属云、云电脑等

- 苹果推出新功能:允许开发者提高订阅价格

- 腾讯音乐娱乐集团推出启明星音乐助手

- 苹果推出自动续订新功能,但有一些限制

- 苹果ios16有望推出全新交互方式

- 群晖推出PB级高密度服务器:可扩充至300个盘位

- 卢伟冰暗示redmi将推出骁龙8plus

- 音乐版《剪映》就要来了!抖音推出全新音乐编辑器《海绵乐队》