yannlecun:人们应该怀疑潜在的符号逻辑

YannLeCun:人们应该怀疑深度学习是否已达到极限 。

自从今年三月份GaryMarcus发表了「深度学习撞墙了」这个观点 , 人工智能学界就陷入了一波又一波的争论 。

争议初期 , 深度学习三巨头还对此保持沉默 。但在本月初的一场播客节目中 , GeoffreyHinton率先驳斥了GaryMarcus 。

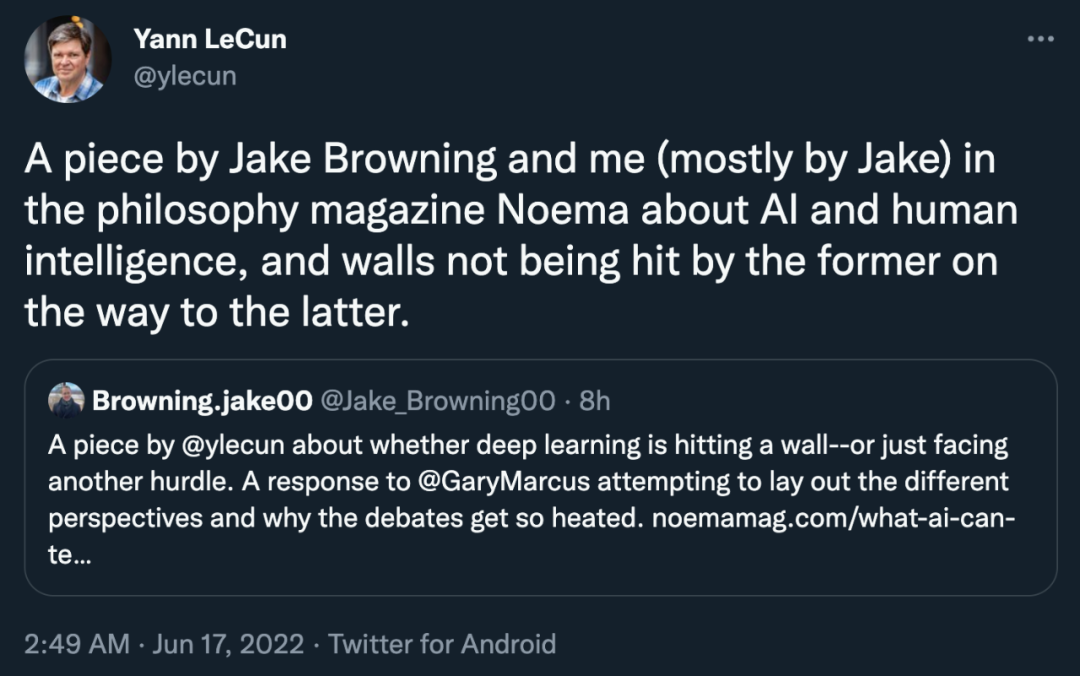

Hinton说完 , YannLeCun也发声了 。

近日 , 美国NOEMA杂志发表了一篇题为《WhatAICanTellUsAboutIntelligence》的署名文章 , 作者是图灵奖得主YannLeCun和纽约大学计算机科学系博士后JacobBrowning二人 。

文章图片

文章图片

在这篇文章中 , YannLeCun和JacobBrowning探讨了人工智能和人类智能的一些问题 , 且首次正式回应「深度学习撞墙了」这个观点 。

文章图片

文章图片

文章内容如下:

当代人工智能的主要技术是深度学习神经网络 , 这是一种大规模的自学习算法 , 擅长识别和利用数据中的模式 。从一开始 , 批评者就过早地认为神经网络已经遇到了不可翻越的墙 , 但每次都被证明只是一个暂时的障碍 。

1960年代 , 他们无法求解非线性函数 , 这个问题在1980年代随着反向传播的出现解决了 。很快又出现了新的障碍——训练系统的难度 。1990年代出现了简化程序和标准化架构 , 这使得训练更加可靠 , 然后新的问题又变成了缺乏训练数据和计算能力 。

2012年 , 当显卡可以在海量ImageNet数据集上进行训练之后 , 深度学习成为了主流 , 轻松击败了所有竞争对手 。但随后批评者发现了一个新问题:深度学习需要太多手工标记的数据进行训练 。

过去几年 , 这种批评变得毫无意义 , 因为自监督学习已经产生了令人难以置信的卓越系统 , 例如不需要标记数据的GPT-3 。

今天看似不可逾越的墙是符号推理 , 即以代数或逻辑的方式操纵符号的能力 。我们知道 , 解决数学问题需要根据严格的规则逐步处理符号 。作为《TheAlgebraicMind》的作者和《RebootingAI》的作者之一 , GaryMarcus最近声称深度学习无法进一步取得进展 , 因为神经网络在处理符号操作方面存在困难 。然而 , 许多深度学习研究人员确信深度学习已经在进行符号推理并将持续改进 。

【yannlecun:人们应该怀疑潜在的符号逻辑】这是一场关于深度学习前景的辩论 。辩论的核心是对符号在智能中的作用存在两种不同的看法:一种认为符号推理必须从一开始就被硬编码 , 另一种认为机器可以像人类一样从经验中学习 。这涉及到我们应该如何理解人类智能 , 进而去追求人类水平的人工智能 。

两种类型的人工智能

符号推理需要精确的计算规则 。例如 , 符号可以有许多不同的顺序 , (3-2)-1和3-(2-1)的区别很大 , 以正确的顺序执行正确的规则至关重要 。Marcus认为 , 这种推理是认知的核心 , 对于为语言提供潜在的语法逻辑和数学的基本操作至关重要 。更广泛地说 , 他认为因果推理等更基本的能力背后有一个潜在的符号逻辑 。

实际上 , 人工智能领域始于研究这种推理 , 通常称为符号人工智能 , 或「老式人工智能(GOFAI)」 。但是 , 将人类专业知识提炼成一套规则是非常困难、耗时且高成本的 。这被称为「知识获取瓶颈」 。虽然为数学或逻辑编写规则很简单 , 但世界本身却非常模棱两可 , 事实证明 , 不可能编写管理所有的模式规则或为模糊概念定义符号 。

- “元宇宙不能脱实向虚,应该以虚强实”

- 实验室主任在ISO 15189认可准备中应该扮演什么样的角色

- 夏天第一烦!到底应该怎么消灭蚊子?看完懂了

- 安康码的这些“隐藏功能”,你应该要了解!

- 支付宝蚂蚁庄园2022年5月26日答案更新(当收到短信,声称可提供内幕消息,推荐股票包赚,应该?5月26日答案分享)

- 支付宝蚂蚁庄园2022年5月26日答案更新(如果牙齿上出现小白点,我们应该?5月26日答案分享)

- 显卡价格天天崩盘,现在应该买么?

- 每个绿带都应该知道的事

- 你觉得苹果鼠标应该怎么做?

- 支付宝蚂蚁庄园2022年4月30日答案更新(人们将犬子作为对自己孩子的谦称,其实犬子本来是?4月30日答案分享)