华为发布业内最大2D自动驾驶数据集,10倍于Waymo,主打半/自监督学习

韦丽雪 发自 副驾寺

智能车参考 报道 | 公众号 AI4Auto

人类司机开车 , 陌生的路开多了自然就会熟练 。

自动驾驶开车 , 需要大量的学习和训练 。

这就离不开提供“训练场地”和素材的庞大数据集 。

此前 , Waymo拥有最大的2D自动驾驶数据集 。

不过现在 , 华为诺亚方舟实验室联合中山大学发布了新一代2D自动驾驶数据集SODA10M 。

文章图片

文章图片

比Waymo现有的大10倍 。

包括了1000万张无标注图片以及2万张带标注图片 。

除了大 , 这个数据集还有什么不同?

数据集从哪里来?

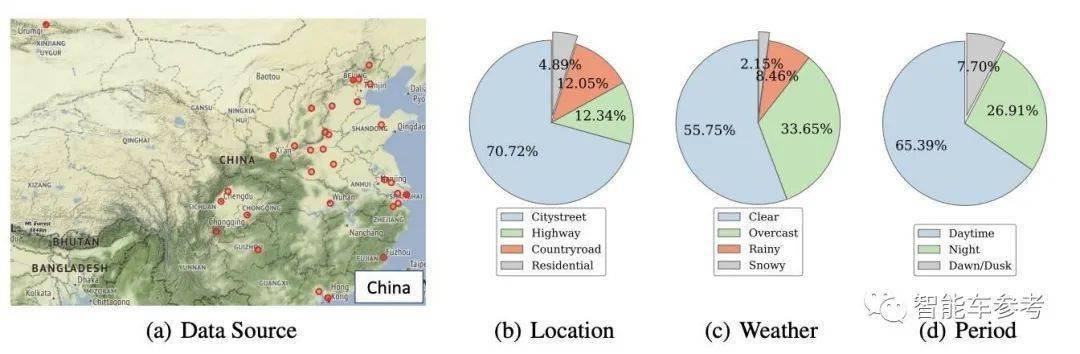

SODA10M数据集收集了不同城市在不同天气条件、时间段以及位置的场景 。

晴天雨天、白天夜晚、城市高速园区……

更重要的是 , 覆盖面很广 。

1000万张无标注图片来自32个城市 , 囊括了国内大部分地区 。

文章图片

文章图片

2万张带标注的图片 , 直接标出了6种主要的人车场景类别 , 分别是:

Pedestrian、Cyclist、Car、Truck、Tram、Tricycle 。

具体是怎么操作的?

华为通过众包方式把采集任务分发给上万名出租车司机 。

由出租车司机使用手机或驾驶记录仪(1080P+)采集图片 。

你以为随手拍个照片就完事?

文章图片

文章图片

还要以每10秒一帧的速度 , 在不同的天气条件下采集图像 。

地平线需要保持在图像的中心 , 遮挡汽车内部不能超过15% 。

对收到的图像还会随机选择其中的5% , 进行手工验证 。

合格率低于95%将退回 。

针对涉及隐私的信息 , 例如人脸和车牌等都会进行模糊处理 。

最大数据集有啥用?

华为用已标注的训练集(2万张带标注的图片) , 搞了一场自动驾驶的主流模型的大pk 。

文章图片

文章图片

对象是全监督、半监督和自监督学习 。

分为训练、验证和测试三个环节 。

为了增加难度 , 最终测试选择的图片是上海白天晴天 , 而且是城市场景 。

在验证这一环节 , 则包含了多种不同场景下的图片 。

最终结果表明 , 仅仅通过全监督训训练出来的模型取得的效果并不好 , 全监督训练的结果夜晚与白天的精度差距大 。

此外 , 华为还把Waymo自动驾驶数据集、现有的经典自监督算法数据集ImageNet拉来 , 和SODA10M的表现进行比较 。

从这三项入手:

1、目标检测;

2、BDD100K(伯克利发布的大型开放驾驶视频数据集);

3、Cityscapes上的语义分割 。

效果如何?

文章图片

文章图片

在Moco系列(城市景观语义分割) , 以及基于像素和中间层特征的自监督方法DetCo, DenseCL上 , SODA10M自监督训练的效果与ImageNet相仿 。

两者都明显优于Waymo 。

文章图片

文章图片

这也意味着自监督算法上游的数据集大小 , 对于下游的学习和测试有极大影响 。

据华为介绍 , 建立这个数据集主要是为了通过自监督学习 , 构建下一代工业级自动驾驶系统的方法 。

- 线上新书发布!云上带你了解有关“冬奥”的那些事儿

- 高德联合清华发布报告:北京绿色出行意愿全国第一

- 2021年度中国互联网辟谣优秀作品即将发布

- TGA创始人|TGA创始人发布EA、育碧等游戏公司市值(微软可以尝试收购一下())

- 2021年度网友留言250个高频词!网上民声重磅发布

- 苹果iphonese或提前到2023年发布

- 威刚发布ISSS13AP 4TB工业级2.5英寸SATA SSD

- 云创智采 发布“智慧采购管理平台2.0”产品

- Therabody发布Theragun mini 新年限量红色版

- 宁德时代电服发布换电品牌evogo与组合换电整体解决方案