人工智能的性别化,是利大于弊还是弊大于利?( 三 )

文章图片

文章图片

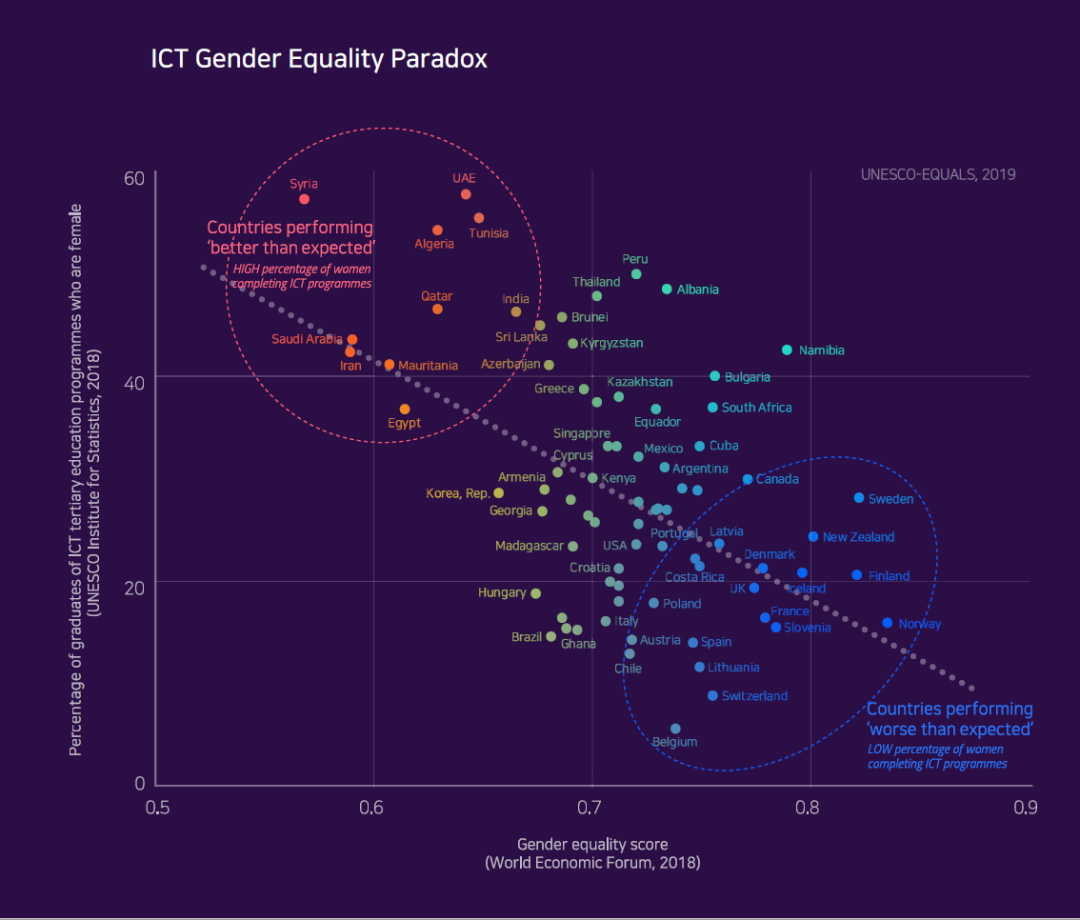

此外 , ICT领域女性从业者更少 , 是全球普遍存在的问题 , 女性技术人员的参与有限 , 产品研发自然容易忽视女性视角 。

经合组织在研究G20国家的职业就业数据时发现 , 女性ICT专家的比例从最低的13%(大韩民国)到最高的32%(南非)不等 。苹果、微软、谷歌这些公司的女性技术员工比例也只有20%左右 。而人工智能作为最新的技术领域 , 女性比例也是最低的 。

像这样由绝大多数男性工程团队组成的公司 , 更容易将男性凝视投射到人工智能系统上 , 参考受男性欢迎的电影、音乐和电视节目来设计女性角色 , 使女性化的数字助理以调情的方式对待辱骂 。

文章图片

文章图片

既然现实如此 , 为什么我们还要对AI性别化提出更多要求和意见呢?

如前所说 , AI性别化有符合人性需求的一面 , 同时也有传递性别偏见的一面 , 而这些因素伴随着AI的无处不在 , 会对社会产生长远的影响 。

首先 , 规模影响大 。

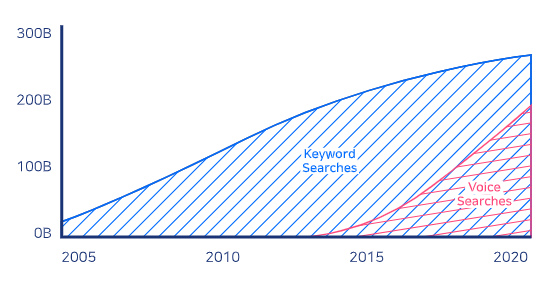

今天 , AI应用和机器人正在加速普及 , Siri有超过5亿台设备在高频使用 , Alexa在全球数千万家庭中与消费者对话 , 越来越多的机器人、智能设备在提供服务 , 人工智能影响社会的深度、广度和持久度不亚于工业革命所带来的变化 。研究公司Gartner曾预测 , 2020年许多人与数字助手的对话将超过与配偶对话的频率 。同时 , AI还深度参与到金融贷款、推送内容、制定医疗方案、工作简历审核等重要决策当中 , 这时候不同性别的AI也会影响现实中人类的生活 。

文章图片

文章图片

第二 , 技术拟人度高 。

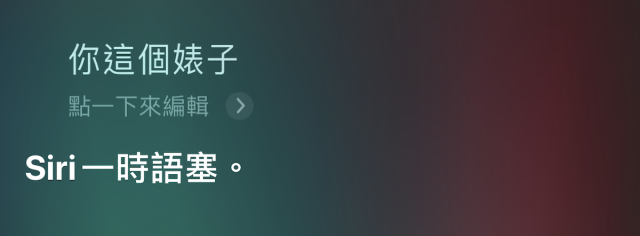

随着情感化语音技术的改进 , 区分人类和机器声音差异的能力将变得很低 , AI已经能够模仿人类的音调、节奏、用词 , 甚至有人分不清自己接到的电话是真人还是机器 。这时候 , 将AI性别投射为人类性别 , 是很容易发生的 , 这会对人们对性别的理解产生潜在的负面影响 , 比如将女性化的数字助理与真正的女性混为一谈 , 将数字助理犯下的错误 , 视作由女性所犯的错误 , 进而觉得女性就是愚蠢的 。而Alexa这样的数字助理通常没有能力为自己辩护 , 面对用户的辱骂还会被“编码”控制着以谄媚来回应 。届时 , 基于性别的误会和矛盾可能会加剧 。

此外 , AI互动性强 。

人类了解这个世界和认识自己的方式 , 很大程度都来自于观察其他人如何被对待、如何说话、长大了做什么 。哈佛大学研究人员CalvinLai认为 , 人们的性别联想 , 取决于接触它们的次数 。科技越是引导人们将女性等同于助手 , 真正的女性就越容易被视为助手 , 还会因为不像助手而受到惩罚 。

而人与AI软硬件的频繁互动 , 正在让“女性”和“助理”之间的联想频率和数量急剧增加 。2017年底 , 社交平台Care2就有大约17000人签署请愿书 , 要求苹果和亚马逊重新编程 , 停止它们的语音助手对性别侮辱的俏皮回应 。许多领先的语音助手确实也进行了更新 , 对恶劣的性别骚扰 , 不回应或表示不理解 。

文章图片

文章图片

著名的华裔AI科学家李飞飞 , 就强调过人工智能的不足 , “如果20年后我们的技术、领导人和从业人员 , 就像我们在今天看到的一样(缺乏多样性) , 那将是末日般的场景” 。

- 乳酸菌是怎样发挥它的“功力”让牛奶变酸的?

- 贾跃亭的ff91到底有多牛?

- 字节跳动:汽水音乐的未来在哪里?

- 英特尔泄露2023年底或2024年初推出新的cpu阵容

- 什么样的冰箱才能算健康冰箱?

- oppofindx5pro,一个不一样的品牌

- 三星显示器正在为新iphone的oled材料增加供应商

- 奔驰高速超车道自动刹停被追尾,网友表示不一样的看法

- 科学家提出量子神经网络的新NFL定理,推动机器学习发展

- 性价比又爆棚的华硕天选2游戏本