人工智能的性别化,是利大于弊还是弊大于利?( 四 )

站在智能时代的门前 , AI表现出的性别偏见 , 确实应该让一些人感到“脸红” 。

那么问题来了 , 面对AI性别化导致的错位 , 人类究竟该如何纠偏?

短期来看 , 先要结束默认性别的操作 。

既然性别刻板印象一时半会儿也改变不了 , 那么不如先让机器“性别中立” , 深度学习技术的先驱YannLeCun , 也建议开发者确保机器具有非人类的智能形式 , 并保持人工智能的人工性 。

现在中国、美国都出现了很多以猫、狗等无性别的动物作为形象的语音助理及机器人 。在Slack和FacebookMessenger平台上工作的虚拟助理Kip , 就将自己表述为一只企鹅 。谷歌还制定了一项政策 , 始终要求人工智能来电者声明自己不是人类(自然也就没有性别了) 。

这样现实中的男性也好、女性也好 , 才能够避免被与AI性别标签联系起来 。尤其是对儿童来说 , 智能机器人或AI老师要明确地告诉孩子它不是男孩或者女孩 , 它只是一个机器人 , 没有性别 。

如果非要出现人性化的声音 , 也应该避免默认性别 , 允许并提示用户 , 在男性和女性之间进行选择 。

文章图片

文章图片

中期来说 , 技术领域应该主动探寻多样性的产品 。

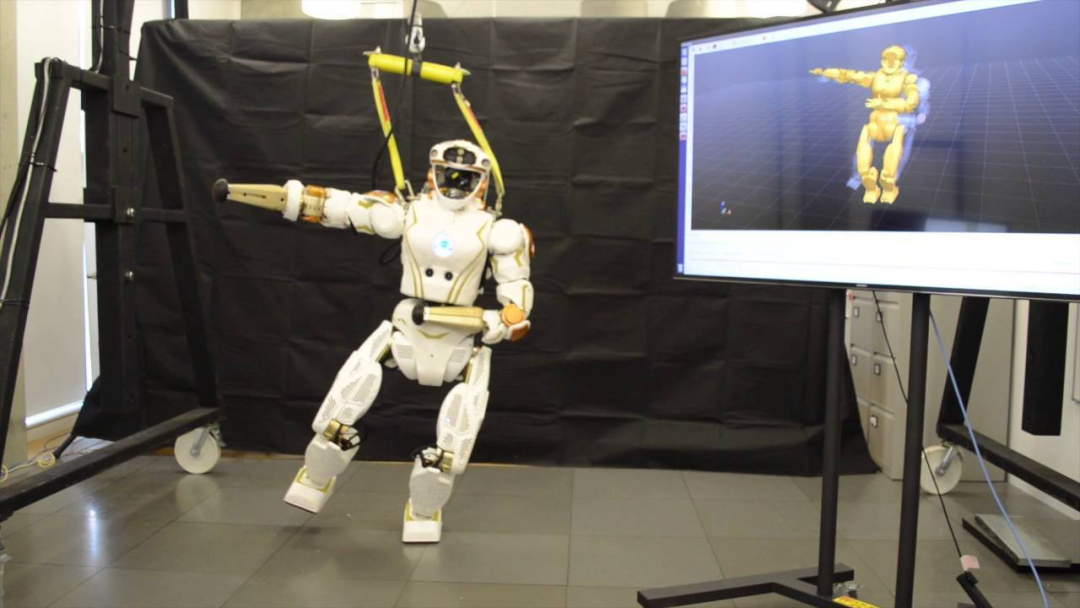

目前还没有明确的法律、政策来强制要求AI将自己识别为机器 , 避免过度性别化的表达 。但一些有远见的人已经开始尝试寻找改变 。比如NASA约翰逊航天中心就推出了一个女性救援机器人 。科学家Radford和他的团队 , 模仿了北欧神话中女武神的形象 , 建造出了一个能够驾驶汽车、爬楼梯、装备有急救设备和盔甲的机器人Valkyrie , 能够在灾难中帮助人类 。这位科学家表示 , 自己7岁的女儿 , 已经爱上这个机器人 , 并以她为灵感进行创作 。

另外 , 很多AI的性别偏见来自于训练语料中的“脏数据” , 因此 , 建立性别敏感的AI公共数据库也十分重要 。这样技术人员就可以直接使用无偏见的数据集来进行训练 , 开发产品 , 避免了一些公司绕开公众监督之后开发一些“谄媚”的AI应用 。

文章图片

文章图片

而从长远来看 , 更好的AI一定是需要情感、需要人性的 。

既然无法从根本上回避性别 , 那么增加ICT领域的女性从业数量 , 尤其是鼓励更多女性投身AI开发 , 才能从源头上既赋予AI以温度 , 同时避免偏见 。

而要弥合性别数字鸿沟 , 依靠的并不是一次针对女孩的编程课 , 或者一期女开发者训练营 。它需要重塑妇女和女孩在数字技能方面的学习体系 , 提供从幼儿教育到职业发展教育的一系列支持 , 使她们能够坚持对AI的兴趣 , 并在技术团队中承担领导角色 。更重要的是 , 女性意识并不是与生俱来的 , ICT女性从业者也需要被鼓励和培养女性意识及技术伦理思维 , 才有能力识别并纠正那些AI产品中的性别偏见 。

数字技术刚刚开始改变社会和经济生活 , 我们很快就会生活在一个AI无处不在的世界中 , 让AI学会如何跟我们沟通 , 对每个人都很重要 。

庆幸的是 , 女性与AI , 都有着无限的潜力与可塑性 。

本文来自微信公众号“脑极体”(ID:unity007) , 作者:藏狐 , 36氪经授权发布 。

- 乳酸菌是怎样发挥它的“功力”让牛奶变酸的?

- 贾跃亭的ff91到底有多牛?

- 字节跳动:汽水音乐的未来在哪里?

- 英特尔泄露2023年底或2024年初推出新的cpu阵容

- 什么样的冰箱才能算健康冰箱?

- oppofindx5pro,一个不一样的品牌

- 三星显示器正在为新iphone的oled材料增加供应商

- 奔驰高速超车道自动刹停被追尾,网友表示不一样的看法

- 科学家提出量子神经网络的新NFL定理,推动机器学习发展

- 性价比又爆棚的华硕天选2游戏本